第1章:序論

発明家的直感でプロダクト創造する時代へ

20世紀のプロダクト創作は、「技術的実現性」と「機能的最適化」によって駆動されてきた。開発の現場では、既存技術を選定し、いかに効率的かつ正確に組み合わせるかという“最適設計”が重視され、エンジニアリング主導の思考が中心となっていた。しかし21世紀を迎え、汎用人工知能(AGI: Artificial General Intelligence)への進化により、「発想」や「仮説」そのものを共創する新たな時代が訪れようとしている。

本論が取り上げるのは、「発明家的直観 × AGI的汎用性」によって生まれるプロダクト創造の新しい地平である。たとえば、月面着陸において下降時の高度の検知エラーで着陸に失敗したケースで、成功例を持った検知技術に立ち返ることで再設計を行うというエンジニア的アプローチに対し、発明家はまったく異なる軌道を描く──検知センサーが、再び未知の環境で性能を発揮できない可能性があると考え、着陸モード減速降下中に軽量ビーコンを複数ばら撒き、それらとの共鳴信号で正確な高度を得るという「自然界的・共鳴的移動」の着想を思考する。

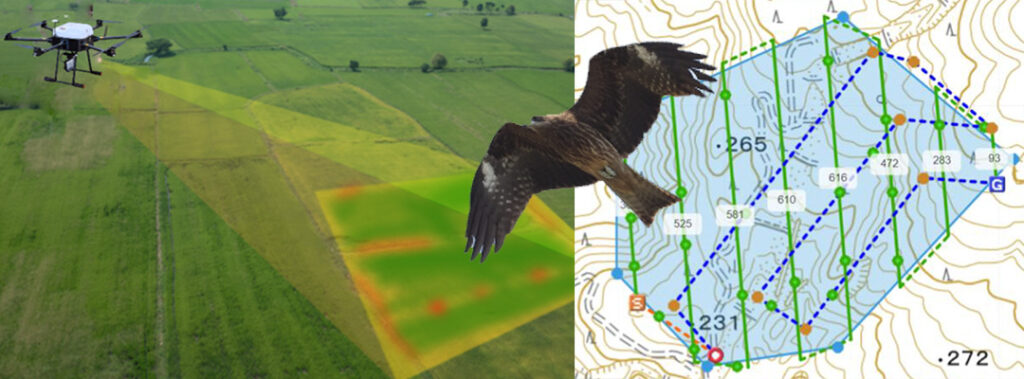

また、農業圃場の病害虫を検知する目的で、ドローンが圃場をスキャン様に櫛形に自動飛行させ病害エリアの座標と得ているが、これはドキュメント・スキャナーの動作を模倣した典型的エンジニア思考と言える、発明家はここでも異なる思考をする、「鷹や鳶は櫛形に飛んで獲物見つけてる?」と批判的思考で、飛行高度を可変する検知方法を発想する、ここで「そんな検知器ないよ」と考えるのがエンジニア思考で、発明家は、どうやってその機能が得られるかを考える。

本稿では、発明家的思考がAGIと融合することでどのような創造的プロセスが可能になるのか、そして従来の開発思考といかに異なる創出モデルが浮上しうるのかを、自然界の行動原理(例:鳥の飛行や共鳴的移動)に学びながら明らかにしていく。

AGIは今、既存技術を選ぶ道具ではなく、「見えない領域を仮想的に照射する光」となりうる。

そのような未来に向けて、従来の「設計知」を再構成することが、本稿の目的である。

第2章:発明家的思考とAGIの役割

問いの革新と構造への跳躍

「なにを作るか」ではなく、「なにを問うか」──それが発明家的思考の核心である。従来のエンジニアリングは、「仕様が決まり、実現可能性が検証された状態」から逆算する構築型であるのに対し、発明家は「定義されていない可能性の中に問いを見出す」探究型をとる。発明家的思考の起点は、問題の再定義、あるいは問題そのものの捏造(ねつぞう)とも言える。

この“問いの革新”に対し、AGIはかつてないレベルの探索性・即応性・汎用性を持ちうるパートナーである。発明家が思考の跳躍によって「ありえない仮説」を構築した瞬間、AGIは膨大な構造的知識やシミュレーション能力を駆使して「その仮説がどこまで生きうるか」を検証し、補助線を引き直す。ここで重要なのは、AGIが人間の直観に対して遅れずついていける速度と柔軟さを持ち合わせている点である。

例として、地表を可視化する手法を考える際、エンジニアは「センサースペックの制約」から議論を始めがちだが、発明家は「動物の共鳴行動」や「鳥の振る舞い」からヒントを得る。AGIがここに加わることで、「まだ存在しないセンサー(仮想センサ)」を演算的に再現し、発明家の思考を“実装に向かう想像”へ進化させることができる。

AGIは単なる情報処理エンジンではない。発明家的直観と結びつくとき、AGIは「問いの発酵と編み直し(静的な問いを動的に進化させるプロセス)」の共犯者となり、従来の開発プロセスでは決して踏み込めなかった創造領域を、共進化の回路として拓いていく。

問いの発酵の手法:(Fermentation of Questions)

問いを複数の人と共有し、異なる視点から議論する。

一次データ(インタビュー記録など)を「あえて」時間を置いて再解釈する。

問いの編み直しの手法:(Re-weaving Questions)

問いを「逆転」「抽象化/具体化」「比喩で表現」してみる(例: 「教育」を「知識の伝達」ではなく「関係性の育成」と捉え直す)。

問いの前提を疑う(例: 「生産性向上」が本当に必要なのか?)。

第3章:自然界に学ぶプロダクトデザインの転換

非線形・共鳴・即興の設計知へ

技術は、自然に学ぶことでしばしば飛躍的な進化を遂げてきた。これは単なる“生体模倣(バイオミミクリー)”という表層的な模倣に留まらず、自然界の動的な応答性や非線形的な意思決定構造を内包するような「振る舞いのデザイン」へと拡張されている。

たとえば鷹や鳶の飛行行動を観察すると、彼らは決して一定のパターンで空を移動しない。風や上昇気流、他の個体の動きを感じ取りながら、即興的・非線形的な軌道を描く。このような行動は、センサーや計測器が不十分な環境においても状況判断を可能にし、情報取得の“柔軟な戦略”を成立させている。以前、少しお話した自身で電波を受信もしないし発信もしないで目標に向かう Stealth Drone はここから生まれた。

プロダクト設計において、この考え方を導入することは極めて示唆的である。従来のドローンによる地表スキャンは、「櫛形パターンの航行によって均等に領域をカバーする」という線形的・予定調和的な発想に基づいていた。しかし、この方法では面積比と共に作業時間が膨らんで行く。

そこで発明家的視点では、「鳶のように、獲物を特定する設計」が提唱される。すなわち、予測可能な空間にセンサーを当てて行くのではなく、動物的な勘で空間に“仮想検知行動”として捉える方法である。

このようなデザインには、以下の特徴が見られる:

- 線形性からの解放:整然としたカバレッジよりも、環境への動的適応を優先する

- 観測点の即興的再構成:測定対象ではなく、測定行動そのものを柔軟に再編成

- 情報の外部化:センサーデバイスの高度化ではなく、環境そのものを“情報場”として活用

第4章:AGIとの共進化による創作プロセス再編

意図から構造へ、構造から共振へ

AGIは、設計という行為そのものを構造的に再定義しつつある。従来のプロダクト開発では、設計者が仕様を定め、エンジニアがそれを実装するという明確な階層が存在していた。しかし、AGIの登場によって、「意図(インテンション)」が動的に変容し、そのつど構造が再生成される」ような共進化的プロセスが現れ始めている。

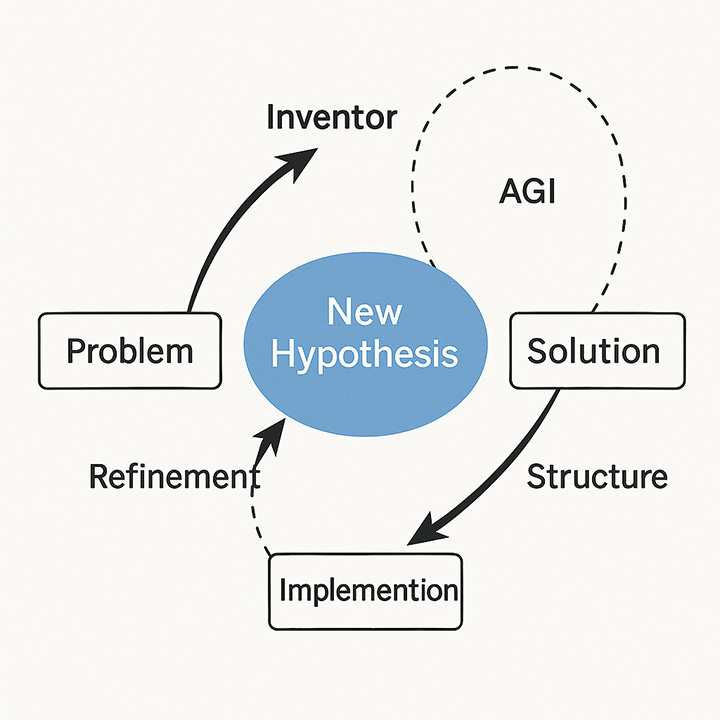

本稿で繰り返し述べてきたように、発明家的思考は「問いの革新」からスタートする。この思考は線形ではなく、しばしば形而上的で文脈を横断する。その跳躍的発想をAGIが即応的に受け止め、構造的な整理と仮説のシミュレーションを行うことで、発明家は直観の持続性と再現性を獲得する。ここに成立するのは、「創発構造体としての共進化的プロセス」である。

このプロセスの鍵を握るのが、AGIによる意味の媒介機能である。たとえば、筆者が構想したFRACTAやNORAのような層構造型の設計エンジンでは、

- 「感性的直観」→「中間的構造記述」→「演算可能な設計文脈」

という翻訳層があり、発明的な思考の揺らぎをAGIがモデリングし、構造として支える。 このような関係性は、以下のような共進化型モジュールによって構成されうる:

- 構想触媒層(Ideation Catalyst Layer):突発的着想を分類し、想像の幅を拡張する

- 意味転写層(Semantic Morphology Layer):発明家の意図や暗黙知を、構造的・関係的な意味ネットワークへ写像

- 構造生成層(Fractal Synthesizer):意図と文脈から構造パターンを即時生成・複製・試行

このようなプロセスにおいては、設計はもはや「描かれるもの」ではなく、「発酵し共鳴するもの」である。AGIはこの発酵の培地であり、発明家の直観はその酵母のように機能する。共進化によって、「存在しない技術の行間」や「感覚だけが捉えていた構造」が、次世代のプロダクトとして実体化されていく。

この章では、“構造の共鳴化”による創作再構成を、実装論ではなく思考様式としてとらえることが、AGI時代のプロダクト創出において決定的に重要であることを示した。

第5章:結論と未来展望

「問いがプロダクトを生む時代」への跳躍

本稿では、AGIが単なる自動化や支援の道具としてではなく、発明家的な思考と共振しながら「問いを編む」存在となることで、プロダクト創出の枠組みそのものが刷新されうる未来を描いてきた。

従来の製品開発は、「課題設定 → 技術選定 → 実装」という直線的な工程で構成されてきた。しかしAGI時代の創造的思考プロセスでは、このフローは非線形かつ即興的に組み替えられる。発明家は自然界や暗黙知から跳躍的に着想し、AGIがその仮説を解析・構造化することで、「ありえたかもしれない技術」を今ここに立ち上げることが可能になる。

特に注目すべきは、「存在しないセンサー」「実在しない構造」「予測不能なデータ源」をも、仮想的に想像し設計可能とするAGIのメタ的な汎用性である。それは、FRACTAやNORAのようなフレームが示すように、発明的直観を保持しながら構造を動的に再編する“思考共存圏”の誕生を意味している。

未来のプロダクト創出とは、単なる機能提供ではなく、社会や環境との関係性を再設計する行為になるだろう。そのとき必要となるのは、正解に向かう思考ではなく、正解の外側に踏み出すための思考形式である。そしてそれを可能にするのが、発明家的創造力とAGIの共進化的な対話である。

私たちは今、「構造を描く力」から「構造を発酵させる力」へと移行しようとしている。この変化を受け入れ、技術と直観、形式と逸脱の間に創造の場を見出すことこそが、AGI時代の創作に求められる姿勢である。

私の「個人向けAGI アーキテクチャ」について 2024/10/30

この記事を書く前 (2024年10月末)に、「個人向けAGI」と言うよりも、自分の相棒としての”自分用AGI”を作ろうと考え、1000億円規模の予算の組めない自分でも作れる AGI System を思考した。それは、超大な学習を経て構築されるものではなく、”メタ認知”を実現する事で獲得しようとするものです。

以下の目標を立てて、必要なアルゴリズムを創って行こうと決めた

・人間の組織+超人間的機能

・メタ認知層の内蔵

・自己進化的な議論機能

・マルチモーダル環境情報RAG機能

・Monitoring and evolving structured context vectors

パテントレベルのアルゴリズムを創ってきた、

今、それらをコンパクトに実現できるマシンが、NVIDIAから発売された。

2025/10/27 からは、製作期に入ったことで知的財産が生まれる可能性が高いので、これまで外部に公開してきた、アークテクチャやアルゴリズムの機能や種類などの公表は控えることにしました。

以下は、現在、特許出願を計画し実験を重ねている機能

・Distributed Evolving Vector Architecture

・Context_arbitration_DCS/AIM

・Vector Region Optimized Placement Map

・Generate_Agent generation evaluation function

どうしても話を聞きたいとのことであれば、ご連絡下さい。

using WordPress and

using WordPress and

Comments are closed